Ведущая детская благотворительная организация призывает премьер-министра Риши Сунака разобраться с изображениями сексуального насилия над детьми, созданными ИИ, когда этой осенью в Великобритании пройдет первый глобальный саммит по безопасности ИИ.

Организация Internet Watch Foundation (IWF) удаляет из Интернета материалы, содержащие оскорбления, и говорит, что количество изображений с искусственным интеллектом растет.

В прошлом месяце IWF впервые начала регистрировать изображения ИИ.

Он обнаружил хищников по всему миру, которые делились галереями иногда фотореалистичных изображений.

«В настоящее время мы не видим таких изображений в огромном количестве, но нам ясно, что у преступников существует потенциал для создания беспрецедентного количества реалистичных изображений сексуального насилия над детьми», — сказала Сьюзи Харгривз, исполнительный директор IWF.

Би-би-си показали отредактированные версии некоторых изображений, на которых были изображены пятилетние девочки, позирующие обнаженными в сексуальных позах.

IWF — одна из трех благотворительных организаций в мире, имеющих лицензию на активный поиск в Интернете контента, посвященного жестокому обращению с детьми.

Он начал регистрировать изображения ИИ 24 мая и сообщает, что к 30 июня аналитики провели расследование на 29 сайтах и подтвердили наличие семи страниц, на которых размещены галереи, содержащие изображения ИИ.

Благотворительная организация не подтвердила точное количество изображений, но говорит, что десятки изображений искусственного интеллекта были смешаны с реальными материалами о злоупотреблениях, распространяемыми на нелегальных сайтах.

Некоторые из них были тем, что эксперты относят к изображениям категории А — наиболее графическим из возможных, изображающим проникновение.

Создание изображений сексуального насилия над детьми является незаконным почти во всех странах.

«Теперь у нас есть шанс опередить эту появляющуюся технологию, но законодательство должно учитывать это и соответствовать цели в свете этой новой угрозы», — сказал Харгривз.

В июне Сунак объявил о планах проведения в Великобритании первого в мире глобального саммита по безопасности ИИ.

Правительство обещает собрать вместе экспертов и законодателей, чтобы рассмотреть риски, связанные с искусственным интеллектом, и обсудить, как их можно снизить с помощью скоординированных на международном уровне действий.

В рамках своей работы аналитики IWF фиксируют тенденции в изображениях насилия, например, недавний рост так называемого «самостоятельно созданного» контента насилия, когда ребенка принуждают отправлять видео или изображения самого себя хищникам.

Благотворительная организация обеспокоена тем, что изображения, созданные ИИ, становятся растущей тенденцией, хотя количество обнаруженных изображений по-прежнему составляет лишь небольшую часть от другого контента со злоупотреблениями.

В 2022 году IWF зарегистрировала и попыталась отключить более 250 000 веб-страниц, содержащих изображения сексуального насилия над детьми.

Аналитики также записали разговоры между хищниками, которые поделились советами о том, как создать максимально реалистичные изображения детей.

Они нашли руководства о том, как обмануть ИИ, чтобы он рисовал изображения оскорблений, и как загрузить модели ИИ с открытым исходным кодом и устранить барьеры безопасности.

В то время как большинство генераторов изображений AI имеют строгие встроенные правила, запрещающие пользователям создавать контент с запрещенными словами или фразами, инструменты с открытым исходным кодом можно загрузить бесплатно и настроить по желанию пользователя.

Самый популярный источник — Stable Diffusion. Его код был опубликован в сети в августе 2022 года группой немецких ученых в области искусственного интеллекта.

BBC поговорила с создателем изображений ИИ, который использует специализированную версию Stable Diffusion для создания сексуализированных изображений девочек-подростков.

Японец заявил, что его «милые» изображения были оправданы, и сказал, что «впервые в истории можно создавать изображения детей, не эксплуатируя настоящих детей».

Однако эксперты говорят, что изображения могут нанести серьезный вред.

«Я не сомневаюсь, что изображения, созданные искусственным интеллектом, будут усиливать эти пристрастия, усиливать это отклонение, и это приведет к большему вреду и большему риску причинения вреда детям во всем мире», — сказал доктор Майкл Бурк, специализирующийся на в преступлениях на сексуальной почве и педофилах для Службы маршалов США.

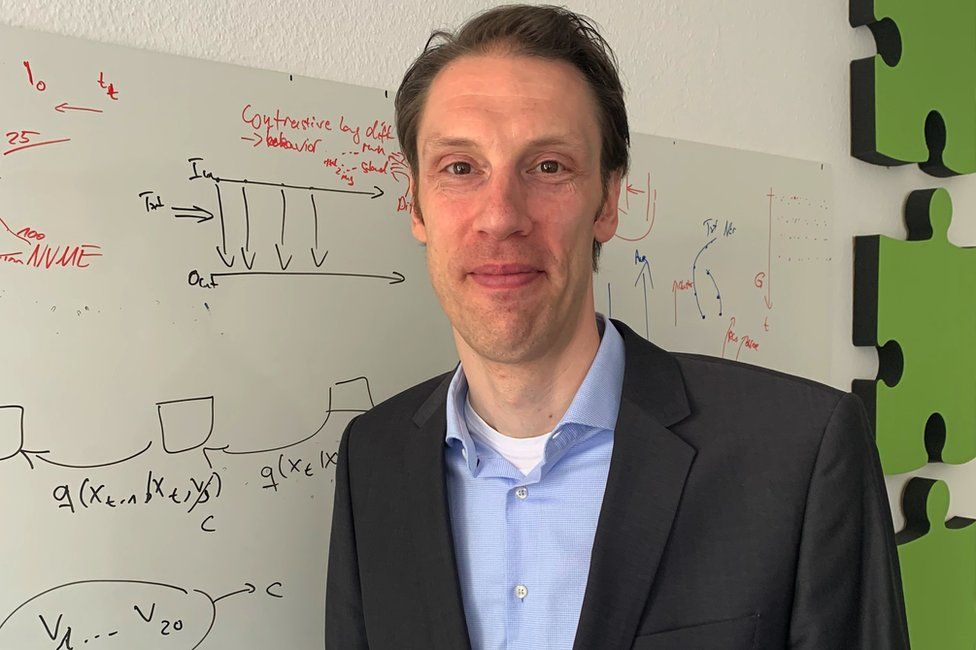

Профессор Бьорн Оммер, один из ведущих разработчиков Stable Diffusion, защищал решение сделать его открытым. Он рассказал Би-би-си, что с тех пор на его основе были реализованы сотни академических исследовательских проектов, в том числе множество процветающих предприятий.

Профессор Оммер предполагает, что это оправдание его решения и решения его команды, и настаивает на том, что останавливать исследования или разработки неправильно.

«Нам действительно нужно признать тот факт, что это всемирное, глобальное развитие. Остановка его здесь не остановит глобальное развитие этой технологии в других странах, которые, вероятно, являются недемократическими обществами. развитие, которое мы наблюдаем, движется быстро», — сказал он.

Stability AI, которая помогла финансировать разработку модели перед запуском, является одной из самых известных компаний, создающих новые версии Stable Diffusion. Компания отказалась от интервью, но ранее заявляла, что запрещает любое неправомерное использование своих версий ИИ в незаконных или аморальных целях.

Зрители из Великобритании могут увидеть больше в программе Newsnight на BBC Two в 22:30 по московскому времени в понедельник или на BBC iPlayer позже.