Кампания с использованием искусственного интеллекта для выдачи себя за Омара аль-Башира, бывшего лидера Судана, получила сотни тысяч просмотров в TikTok, добавление в Интернете смятение в стране, раздираемой гражданской войной.

Анонимный аккаунт публикует, по его словам, «утечку записей» экс-президента с конца августа. Канал выложил десятки клипов — но голос фальшивый.

Башира, обвиненного в организации военных преступлений и свергнутого военными в 2019 году, уже год не видели на публике и предположительно он серьезно болен. Он отвергает обвинения в военных преступлениях.

Тайна, окружающая его местонахождение, добавляет уровень неопределенности в страну, находящуюся в кризисе после того, как в апреле вспыхнули боевые действия между военными, которые в настоящее время командуют, и конкурирующей группой ополченцев Сил быстрой поддержки.

Подобные кампании имеют большое значение, поскольку они показывают, как новые инструменты могут быстро и дешево распространять фейковый контент через социальные сети, говорят эксперты.

«Больше всего меня беспокоит демократизация доступа к сложным технологиям манипулирования аудио и видео», — говорит Хани Фарид, который занимается исследованиями цифровой криминалистики в Калифорнийском университете в Беркли, США.

«Искушенные актеры десятилетиями могли искажать реальность, но теперь обычный человек, практически не имеющий технических знаний, может быстро и легко создавать фейковый контент».

Записи размещены на канале «Голос Судана». Посты представляют собой смесь старых отрывков с пресс-конференций во время попыток переворота, новостных репортажей и нескольких «утекших записей», приписываемых Баширу. Сообщения часто притворяются, что они взяты с встречи или телефонного разговора, и звучат зернисто, как и следовало ожидать от плохой телефонной линии.

Чтобы проверить их подлинность, мы сначала проконсультировались с командой экспертов по Судану из BBC Monitoring. Ибрагим Хайтар сказал нам, что они вряд ли были недавними:

«Голос похож на голос Башира, но он очень болен последние несколько лет и сомневается, что сможет говорить так ясно».

Это не значит, что это не он.

Мы проверили и другие возможные объяснения, но это не всплывший на поверхность старый клип и вряд ли работа импрессиониста.

Наиболее убедительные доказательства предоставил пользователь X, ранее Twitter.

Они узнали самую первую из записей Башира, опубликованную в августе 2023 года. Судя по всему, на ней лидер критикует командующего суданской армией генерала Абдель Фаттаха Бурхана.

Запись Башира соответствовала прямой трансляции Facebook Live, которую двумя днями ранее транслировал популярный суданский политический обозреватель, известный как Аль Инсирафи. Предполагается, что он живет в Соединенных Штатах, но никогда не показывал свое лицо на камеру.

Эта пара не особо похожа по звучанию, но сценарии одинаковы, и когда вы воспроизводите оба клипа вместе, они воспроизводятся идеально синхронно.

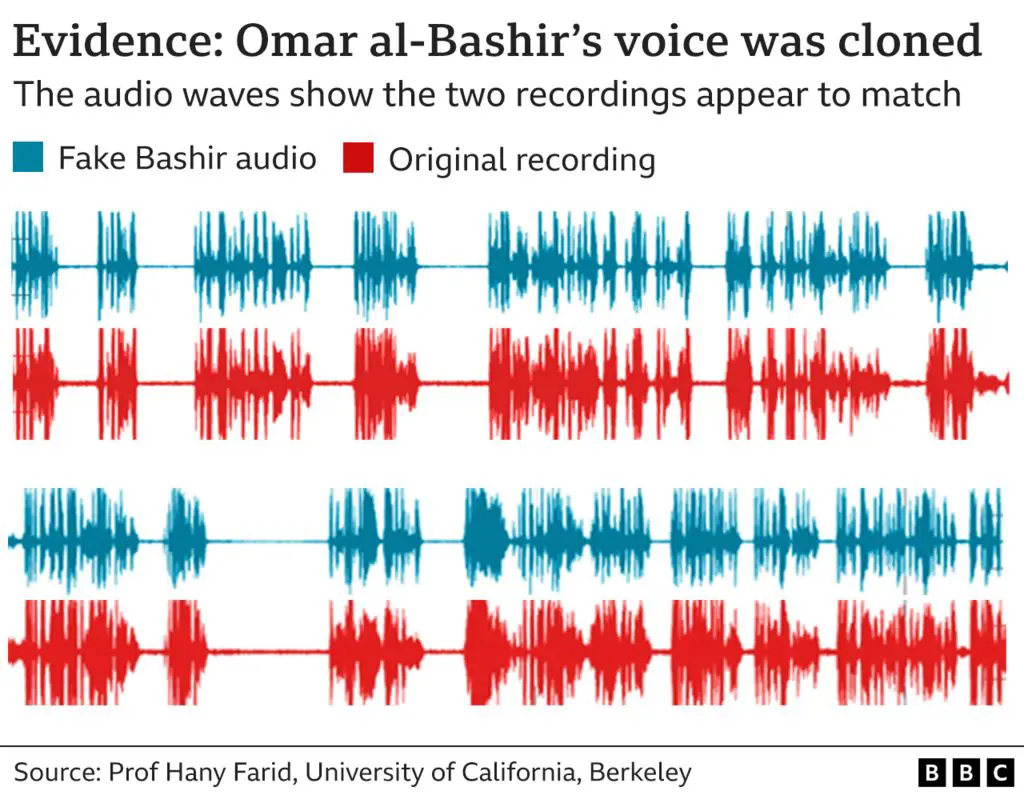

Сравнение звуковых волн показывает схожие закономерности в речи и молчании, отмечает Фарид.

Имеющиеся данные свидетельствуют о том, что для имитации речи Башира использовалось программное обеспечение для преобразования голоса. Программное обеспечение представляет собой мощный инструмент, позволяющий загрузить фрагмент аудио, который можно изменить на другой голос.

После дальнейших раскопок выявилась закономерность. Мы нашли еще как минимум четыре записи Башира, взятые из прямых трансляций того же блогера. Нет никаких доказательств его причастности.

Аккаунт TikTok носит исключительно политический характер и требует глубоких знаний о том, что происходит в Судане, но кому выгодна эта кампания, остается предметом споров. Одним из последовательных повествований является критика главы армии генерала Бурхана.

Мотивация может заключаться в том, чтобы обманом заставить аудиторию поверить в то, что Башир сыграл свою роль в войне. Или канал может попытаться узаконить определенную политическую точку зрения, используя голос бывшего лидера. Каким может быть этот угол, неясно.

«Голос Судана» отрицает, что вводит общественность в заблуждение, и заявляет, что не связан ни с какими группами. Мы связались с аккаунтом и получили текстовый ответ, в котором говорилось: «Я хочу выразить свой голос и объяснить реальность, которую переживает моя страна, в моем стиле».

Попытки такого масштаба выдать себя за Башира можно рассматривать как «значимые для региона» и потенциально способные обмануть аудиторию, говорит Генри Адждер, чья программа на BBC Radio 4 исследовала эволюцию синтетических медиа.

Эксперты по искусственному интеллекту уже давно обеспокоены тем, что фальшивые видео и аудио приведут к волне дезинформации, которая может спровоцировать беспорядки и сорвать выборы.

«Тревожно то, что эти записи могут также создать среду, в которой многие не поверят даже реальным записям», — говорит Мохамед Сулиман, исследователь лаборатории гражданского искусственного интеллекта Северо-Восточного университета.

Как распознать аудиодезинформацию?

Как мы видели на этом примере, люди должны задаться вопросом, насколько запись правдоподобна, прежде чем поделиться ею.

Очень важно проверить, был ли он выпущен надежным источником, но проверить аудио сложно, особенно когда контент распространяется в приложениях для обмена сообщениями. Это еще более сложно во времена социальных волнений, подобных тем, которые сейчас наблюдаются в Судане.

Технология создания алгоритма, способного распознавать синтетический звук, все еще находится на самых ранних стадиях разработки, тогда как технология имитации голосов уже достаточно развита.

После того как BBC связалась с TikTok, аккаунт был забанен.