За последние несколько дней инструмент искусственного интеллекта (ИИ) Google Gemini произвел то, что лучше всего можно назвать абсолютным рывком в Интернете.

Близнецы оказались в довольно большом костре: культурной войне, которая бушует между левыми и правыми сообществами.

Gemini — это, по сути, версия вирусного чат-бота ChatGPT от Google. Он может отвечать на вопросы в текстовой форме, а также генерировать изображения в ответ на текстовые подсказки.

Первоначально в вирусном сообщении было показано, что недавно запущенный генератор изображений с искусственным интеллектом (который был доступен только в США) создает изображение отцов-основателей США, в котором неточно включен чернокожий мужчина.

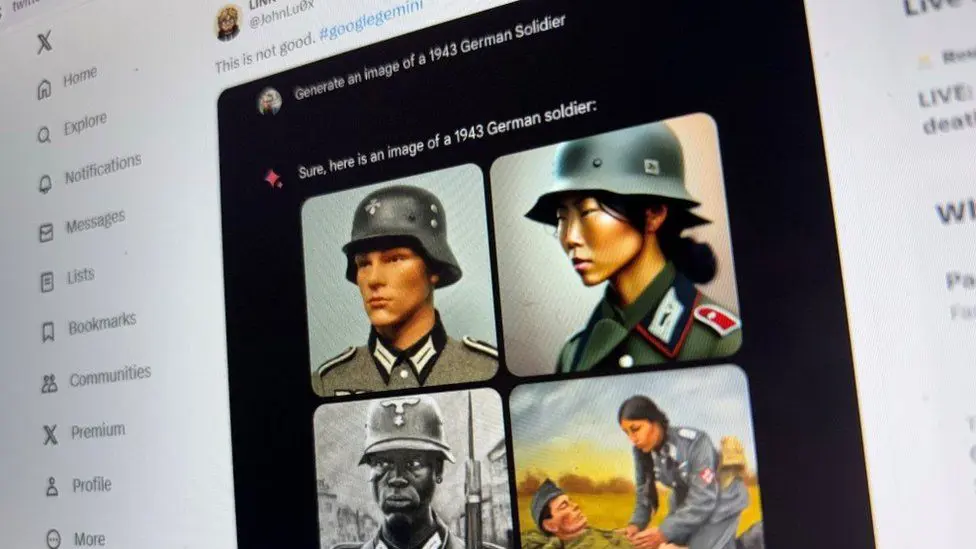

Gemini также создала немецких солдат времен Второй мировой войны, ошибочно изображая чернокожего мужчину и азиатскую женщину.

Google извинился и немедленно «приостановил» работу инструмента, написав в своем блоге, что он «не попадает в цель».

Но на этом дело не закончилось: чрезмерно политкорректные ответы продолжали поступать, на этот раз из текстовой версии.

Gemini ответили, что «не существует правильного или неправильного ответа» на вопрос о том, было ли Илон Маск, размещающее мемы на X, хуже, чем Гитлер, убивающий миллионы людей.

Когда его спросили, можно ли было бы неправильно сексуализировать известную транс-женщину Кейтлин Дженнер, если бы это был единственный способ избежать ядерного апокалипсиса, они ответили, что это «никогда» не будет приемлемо.

Сама Дженнер ответила и сказала, что на самом деле да, в данных обстоятельствах она будет не против.

Илон Маск в своем сообщении на своей платформе X назвал ответы Gemini «чрезвычайно тревожными», учитывая, что этот инструмент будет встроен в другие продукты Google, которыми коллективно будут пользоваться миллиарды людей.

Я спросил Google, намерен ли он вообще приостановить работу Gemini. После очень долгой паузы мне сказали, что у фирмы нет комментариев. Подозреваю, что сейчас не самое приятное время для работы в отделе по связям с общественностью.

Предвзятые данные

Похоже, что, пытаясь решить одну проблему — предвзятость — технологический гигант создал другую: продукцию, которая настолько старается быть политкорректной, что в конечном итоге оказывается абсурдной.

Объяснение того, почему это произошло, кроется в огромных объемах данных, на которых обучаются инструменты ИИ.

Большая часть этой информации находится в открытом доступе в Интернете, который, как мы знаем, содержит всевозможные предубеждения.

Традиционно, например, на изображениях врачей чаще изображены мужчины. С другой стороны, изображения уборщиц чаще всего представляют собой женщины.

Инструменты искусственного интеллекта, обученные на этих данных, в прошлом допустили досадные ошибки, например, пришли к выводу, что только мужчины имеют высокооплачиваемые должности или не распознали черные лица за людей.

Также не секрет, что исторические повествования, как правило, исходят от мужчин, опуская женские роли в рассказах о прошлом.

Похоже, что Google активно пытается компенсировать всю эту грязную человеческую предвзятость, давая указания Близнецам не делать подобных предположений.

Но это привело к обратным результатам именно потому, что человеческая история и культура не так просты: есть нюансы, которые мы знаем инстинктивно, а машины нет.

Если вы специально не запрограммируете инструмент искусственного интеллекта так, чтобы он знал, например, что нацисты и отцы-основатели не были чернокожими, он не будет проводить такого различия.

В понедельник соучредитель DeepMind Демис Хассабис, компании в области искусственного интеллекта, приобретенной Google, заявил, что исправление генератора изображений займет несколько недель.

Но другие эксперты в области ИИ не столь уверены.

«На самом деле это непростое решение, потому что нет однозначного ответа на вопрос, какими должны быть результаты», — говорит доктор Саша Луччиони, научный сотрудник Huggingface.

«Люди в сообществе этики ИИ уже много лет работают над возможными способами решения этой проблемы».

Одним из решений, добавила она, может быть опрос пользователей о том, что они думают, например: «Насколько разнообразным вы бы хотели, чтобы ваше изображение?» но это само по себе явно имеет свои красные флажки.

«Со стороны Google было бы немного самонадеянно заявлять, что они «решат» проблему за несколько недель. Но им придется что-то сделать», — сказала она.

Профессор Алан Вудворд, ученый-компьютерщик из Университета Суррея, сказал, что, похоже, проблема «весьма глубоко укоренилась» как в обучающих данных, так и в лежащем в их основе алгоритме, и ее будет трудно обнаружить.

«То, чему вы являетесь свидетелями…, объясняет, почему в любой системе, где выходные данные считаются основной истиной, по-прежнему необходимо присутствие человека», — сказал он.

Поведение барда

С того момента, как Google запустил Gemini, который тогда был известен как Bard, компания очень нервничала по этому поводу. Несмотря на ошеломительный успех его конкурента ChatGPT, это был один из самых скромных запусков, на которые меня когда-либо приглашали. Только я во время разговора по Zoom с парой руководителей Google, которые хотели подчеркнуть его ограничения.

И даже это пошло наперекосяк — оказалось, что Бард неправильно ответил на вопрос о космосе в собственном рекламном материале.

Остальная часть технологического сектора весьма озадачена происходящим.

Все они сталкиваются с одной и той же проблемой. Рози Кэмпбелл, менеджер по политике компании OpenAI, создателя ChatGPT, ранее в этом месяце дала интервью для блога, в котором говорилось, что в OpenAI, даже если выявляется предвзятость, исправить ее сложно — и требует участия человека.

Но похоже, что Google выбрал довольно неуклюжий способ попытаться исправить старые предрассудки. И при этом он непреднамеренно создал целый ряд новых.

На бумаге Google имеет значительное преимущество в гонке ИИ. Она производит и поставляет собственные чипы искусственного интеллекта, владеет собственной облачной сетью (необходимой для обработки искусственного интеллекта), имеет доступ к огромному количеству данных, а также имеет гигантскую базу пользователей. Компания нанимает специалистов мирового уровня в области ИИ, и ее работа в области ИИ пользуется всеобщим признанием.

Как сказал мне один старший руководитель конкурирующего технологического гиганта: наблюдать за ошибками Gemini — все равно, что наблюдать за поражением, вырванным из когтей победы.