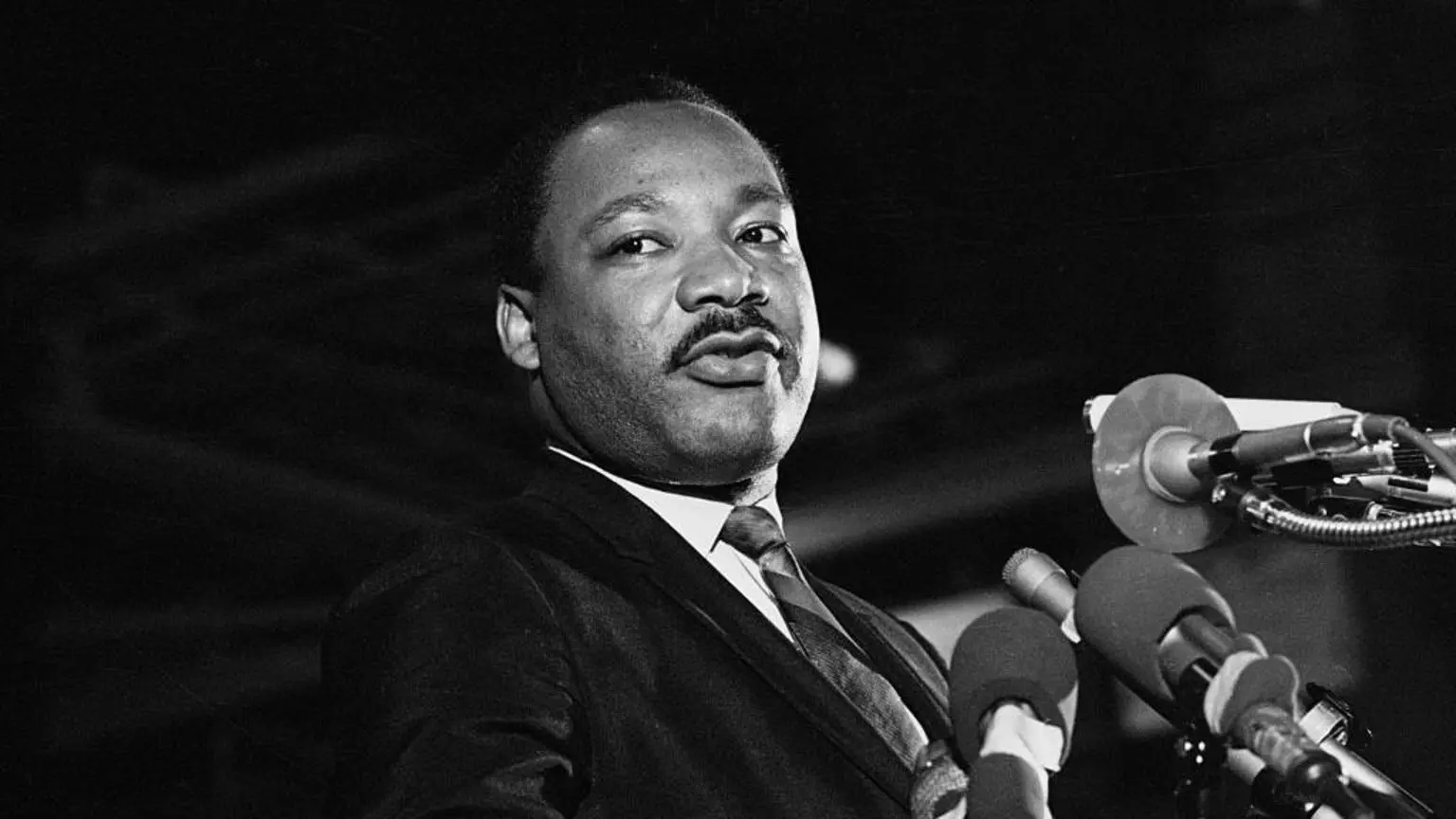

Компания OpenAI прекратила создание своим приложением на основе искусственного интеллекта (ИИ) Sora видео с дипфейками, изображающими доктора Мартина Лютера Кинга-младшего, по просьбе его родственников.

Компания признала, что видеогенератор создал «неуважительный» контент о борце за гражданские права.

Sora стал вирусным в США благодаря своей способности создавать гиперреалистичные видео, что привело к тому, что пользователи стали делиться фейковыми сценами с умершими знаменитостями и историческими деятелями в странных и зачастую оскорбительных ситуациях.

OpenAI заявила, что приостановит показ изображений доктора Кинга, «чтобы усилить контроль над историческими личностями», но при этом по-прежнему позволяет пользователям создавать клипы с другими известными людьми.

Этот подход оказался спорным, поскольку видеоролики с участием таких деятелей, как президент Джон Ф. Кеннеди, королева Елизавета II и профессор Стивен Хокинг, широко распространялись в интернете.

Это побудило Зельду Уильямс, дочь Робина Уильямса, обратиться к людям с просьбой прекратить присылать ей созданные с помощью искусственного интеллекта видеоролики с изображением её отца, знаменитого американского актёра и комика, скончавшегося в 2014 году.

Бернис А. Кинг, дочь покойного доктора Кинга, позже публично обратилась с аналогичным заявлением, написав в интернете: «Я согласна с этим по поводу моего отца. Пожалуйста, прекратите».

Среди созданных с помощью искусственного интеллекта видеороликов, изображающих борца за гражданские права, были некоторые, смонтированные различными способами его скандально известной речи «У меня есть мечта». Газета Washington Post сообщила, что в одном из видеороликов он издавал расистские звуки.

Тем временем в приложении Sora и социальных сетях были опубликованы другие видеоролики, на которых были изображены люди, похожие на доктора Кинга и его коллегу по борьбе за гражданские права Малкольма Икса, которые дерутся друг с другом.

Специалист по этике искусственного интеллекта и писательница Оливия Гамбелин заявила в интервью BBC OpenAI, что ограничение дальнейшего использования изображения доктора Кинга было «хорошим шагом вперёд».

Однако, по её словам, компания должна была принять меры с самого начала, а не внедрять такую технологию методом проб и ошибок.

Она заявила, что возможность создавать дипфейки умерших исторических личностей не только свидетельствует о «неуважении» к ним, но и создаёт дополнительную опасность для понимания людьми подлинного и фейкового контента.

«Это слишком похоже на попытку переписать исторические события», — сказала она.

«Интересы свободы слова»

Рост количества дипфейков — видеороликов, изменённых с помощью инструментов ИИ или других технологий, чтобы показать, что кто-то говорит или ведёт себя не так, как на самом деле, — вызвал опасения, что они могут быть использованы для распространения дезинформации, дискриминации или оскорблений.

В пятницу OpenAI заявила, что, хотя, по её мнению, «существуют сильные интересы свободы слова в изображении исторических личностей», они и их семьи должны иметь контроль над своими изображениями.

«Уполномоченные представители или владельцы наследства могут потребовать, чтобы их изображения не использовались в камеях Sora», — говорится в заявлении.

Так называемые «камеи» на платформе позволяют живым людям давать согласие на использование их лица или внешнего вида в дальнейших видеороликах с использованием ИИ на Sora.

В начале октября OpenAI сообщила BBC, что создала «многоуровневую защиту для предотвращения неправомерного использования».

Также было заявлено, что компания ведёт «прямой диалог с публичными лицами и владельцами контента, чтобы собрать отзывы о необходимых им элементах контроля», чтобы учесть их в последующих изменениях.