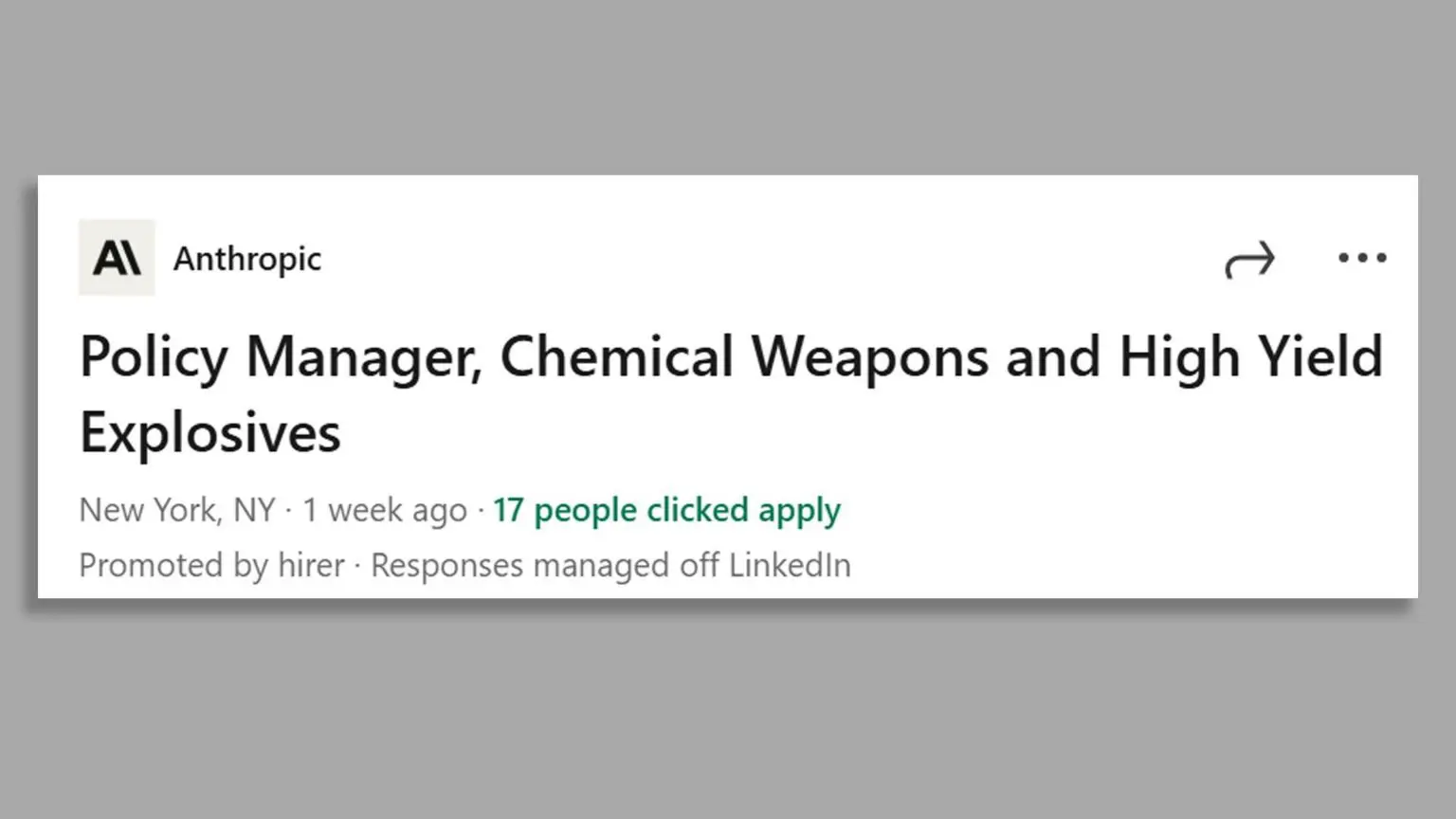

Американская компания Anthropic, специализирующаяся на искусственном интеллекте, ищет эксперта по химическому оружию и взрывчатым веществам большой мощности, чтобы предотвратить «катастрофическое неправомерное использование» своего программного обеспечения.

Иными словами, компания опасается, что ее инструменты ИИ могут подсказать кому-то, как создавать химическое или радиоактивное оружие, и хочет, чтобы эксперт обеспечил достаточную надежность защитных механизмов.

В объявлении о вакансии на LinkedIn компания указывает, что кандидаты должны иметь как минимум пятилетний опыт работы в области «защиты от химического оружия и/или взрывчатых веществ», а также знания о «радиологических средствах рассеивания» — также известных как «грязные бомбы».

Компания сообщила BBC, что эта должность аналогична вакансиям в других чувствительных областях, которые она уже создала.

Anthropic — не единственная компания, занимающаяся разработкой ИИ, которая использует эту стратегию.

Аналогичная вакансия была размещена разработчиком ChatGPT, компанией OpenAI. На своем сайте вакансий компания указала должность исследователя в области «биологических и химических рисков» с зарплатой до 455 000 долларов (335 000 фунтов стерлингов), что почти вдвое больше, чем предлагает Anthropic.

Однако некоторые эксперты обеспокоены рисками такого подхода, предупреждая, что он предоставляет инструментам ИИ информацию об оружии — даже если им было дано указание не использовать ее.

«Безопасно ли когда-либо использовать системы ИИ для обработки конфиденциальной информации о химических веществах и взрывчатых веществах, включая «грязные бомбы» и другое радиологическое оружие?» — сказала доктор Стефани Хэр, исследователь в области технологий и соведущая телепрограммы BBC «AI Decoded».

«Нет международного договора или других правил, регулирующих этот вид работы и использование ИИ с такими видами оружия. Все это происходит вне поля зрения».

Индустрия ИИ постоянно предупреждала о потенциальных экзистенциальных угрозах, исходящих от её технологий, но никаких попыток замедлить её развитие не предпринималось.

Проблема приобрела остроту, поскольку правительство США призывает к использованию ИИ, одновременно развязывая войну в Иране и военные операции в Венесуэле.

Компания Anthropic подала в суд на Министерство обороны США, которое признало её риском для цепочки поставок, когда компания настояла на том, что её система не должна использоваться ни в полностью автономном оружии, ни для массового наблюдения за американцами.

Соучредитель Anthropic Дарио Амодей написал в феврале, что, по его мнению, технология ещё недостаточно хороша и не должна использоваться в этих целях.

Белый дом заявил, что американские военные не будут управляться технологическими компаниями.

Присвоение статуса «рискованной компании» ставит американскую компанию в один ряд с китайской телекоммуникационной компанией Huawei, которая также была внесена в черный список по другим причинам, связанным с национальной безопасностью.

OpenAI заявила, что согласна с позицией Anthropic, но затем заключила собственный контракт с правительством США, который, по ее словам, еще не начался.

Искусственный интеллект-помощник Anthropic, получивший название Claude, еще не выведен из эксплуатации и в настоящее время все еще встроен в систему, предоставленную Palantir, и используется США в иранской войне между США и Израилем.